Il deepfake (parola coniata nel 2017) è una tecnica per la sintesi dell’immagine umana basata sull’intelligenza artificiale, usata per combinare e sovrapporre immagini e video esistenti con video o immagini originali, tramite una tecnica di apprendimento automatico, conosciuta come rete antagonista generativa. E’ stata anche usata per creare falsi video pornografici ritraenti celebrità e per il revenge porn, ma può anche essere usato per creare fake news, bufale e truffe.

La crescita del fenomeno

Ricordate il dipendente che preparò un bonifico da 234 mila euro seguendo la richiesta telefonica del CEO dell’azienda, per poi scoprire che si trattava di una frode? Si tratta solo di uno dei tantissimi esempi di applicazione di questa tecnologia.

Il deepfake è un fenomeno in forte crescita, a livello sia qualitativo sia quantitativo, al punto da essere diventato una nuova arma nell’arsenale della guerra cyber: per danneggiare un’azienda, la reputazione di una persona o le elezioni di un Paese rivale, ad esempio. A fare il punto è il rapporto di Deeptrace, uscito questa settimana, dove risulta che il numero di video deepfake disponibili è raddoppiato rispetto a dicembre 2018 e ora è di 14.678 (a settembre 2019). Per il 96% sono pornografici.

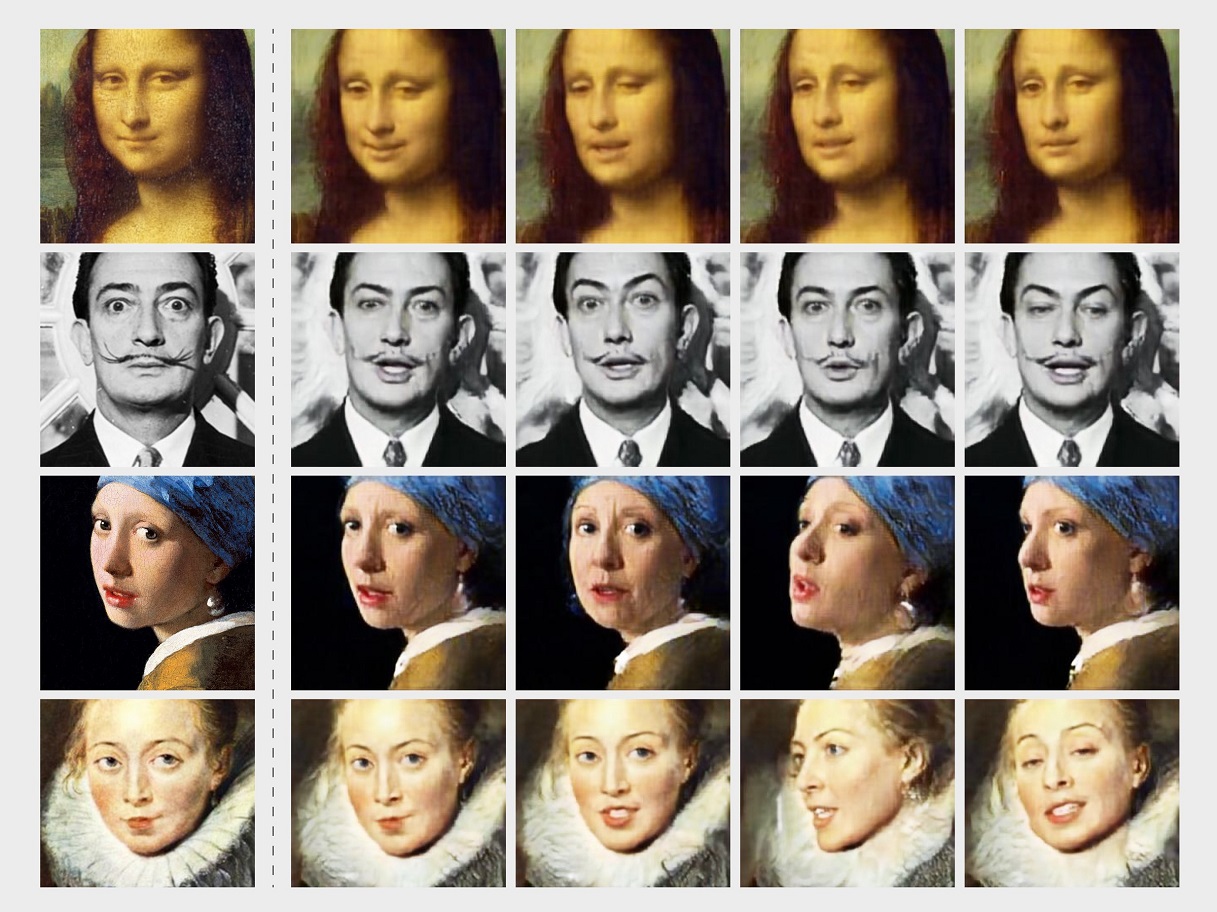

Contraffazioni molto realistiche dove, com’è tipico dei deepfake, si vedono attrici e personaggi famosi fare o dire cose che non hanno mai fatto o detto; il tutto grazie alla sovrapposizione di video e immagini diversi tramite algoritmi di intelligenza artificiale (del tipo deep learning).

This person doesn’t exist

C’è qualcosa di incoraggiante e al tempo stesso di inquietante nell’idea che un ingegnere informatico abbia pensato di realizzare un sito internet (thispersondoesnotexist.com) in cui semplicemente, ogni volta che si aggiorna la pagina, compare un volto diverso, un’immagine assolutamente indistinguibile da una normale fotografia, con l’unica differenza che la persona ritratta non esiste. Scopo del sito sarebbe mostrare alla società di cosa sono capaci gli algoritmi dell’intelligenza artificiale.

Il caso del finto Renzi che a Striscia la Notizia fa gestacci all’indirizzo di Zingaretti e Di Maio non è che l’inizio di un problema che può diventare tragico. Dal momento in cui diviene tecnicamente possibile, attraverso i cosiddetti deepfake, costruire e diffondere video in cui la nostra immagine e persino la nostra voce sono ricostruiti e manipolati in modo da farci dire e fare quello che non ci siamo mai sognati nemmeno di pensare (non era il caso del video di Striscia, evidentemente, ma non ci vorrà molto perché inizino a circolare prodotti migliori), cosa ne sarà del nostro dibattito pubblico, della politica democratica e della stessa convivenza civile, una volta venuta meno la possibilità di stabilire con un ragionevole grado di certezza cosa è vero e cosa è falso?

Il guaio è che da noi l’intero sistema dell’informazione si nutre già abbondantemente di un simile materiale. E il peggio non è che così fan tutti, ma che nessuno ci trova niente di male (o meglio: ognuno ci trova molto di male quando è lui o la sua parte a farne le spese, prontissimo però a restituire il favore agli avversari alla prima occasione).

In compenso, appare incoraggiante la strada scelta dai creatori del sito thispersondoesnotexist.com. Più questo genere di tecnologia diverrà a tutti familiare, infatti, più crescerà la consapevolezza critica. È probabile che di fronte ai primi fotomontaggi in molti si ponessero dubbi angosciosi simili a quelli che oggi noi ci poniamo di fronte ai deepfake.

Resta il fatto che la politica moderna, perlomeno dal 2016 in avanti, come abbiamo visto con la Brexit e con l’elezione di Donald Trump, si gioca sempre di più sul terreno della manipolazione.

La California ha due nuove leggi contro i deepfake

Il governatore della California Gavin Newsom ha firmato due leggi che rappresentano un’importante frontiera nella lotta ai deepfake, i video che mostrano persone vere nell’atto di fare o dire cose inventate con un’accuratezza che non permette di carpirne la falsificazione.

La prima criminalizza chi pubblica video o immagini manipolate dei politici con l’intento di screditarli nei 60 giorni che precedono un’elezione che li vede coinvolti. La seconda, invece, permette a chi si ritrova suo malgrado protagonista di un filmino hard, pur non avendone mai girato uno, di fare causa all’autore del deepfake.

Google combatte i deepfake con migliaia di deepfake

Contro la minaccia dei video manipolati dall’intelligenza artificiale scende in campo con più decisione Big G con il peso della sua tecnologia avanzata che però potrebbe non essere sufficiente per arginare un fenomeno dilagante.

Google ha messo a disposizione un database di migliaia di deepfake per aiutare i ricercatori a identificarli e a impedirne la diffusione. L’intento è quello di riuscire a sviluppare strumenti più efficaci, basati sulla stessa intelligenza artificiale che produce i falsi filmati in circolazione, per stare al passo con i progressi di questa tecnologia, in continua evoluzione.

Tuttavia, l’ascesa del fenomeno dei deepfake, che raggiungono via via livelli di perfezione tale da rendere impossibile distinguere il falso dalla realtà, suscita contemporaneamente grande preoccupazione perché si teme possa aumentare in modo pericoloso disinformazione, confusione e propaganda con gravi ripercussioni in campo sociale e politico.

Jim Carrey interpreta Jack Torrance in Shining

Il ruolo è quello di Jack Nicholson in Shining. Sue anche le espressioni, i gesti, i movimenti. Il volto, però, è quello di Jim Carrey: pettinato e vestito come il protagonista del film, Jack Torrance, calato nella parte e terrificante come non mai. Il filmato,che può ingannare anche l’occhio più attento, è stato realizzato da un singolo individuo, lo youtuber Ctrl Shif Face, aiutato da DeepFaceLab, un popolare software disponibile online.

Lo youtuber ha messo a disposizione dei suoi follower più curiosi anche un collage dei video usati per “addestrare” l’algoritmo che ha prodotto il deepfake: basta guardarlo per rendersi conto che per ottenere un risultato realistico non basta dare in pasto a un software una manciata di foto, ma ne servono molte, di buona qualità e soprattutto capaci di restituire una visione a 360° del volto che si desidera riprodurre.

Come distinguere un deepfake?

Distinguere realtà e funzione, in questi casi, sembra quasi impossibile. E’ convinto ci sia una speranza il Washington Post, che ha messo a punto una guida dal titolo “Seeing isn’t believening”, traducibile come: «Vedere per non credere», destinata a tutti, esperti e non per aiutare i cittadini a districarsi in mezzo a una giungla di video ingannevoli, deepfake inclusi.